Nola identifikatu AArekin sortutako irudiak? Gako batzuk, konpromiso bat eta sen ona findu

Adimen artifizialeko tresnak etengabe ari dira garatzen eta, ondorioz, gero eta zailagoa zaigu jakitea sarean egunero ikusten ditugun irudiak benetakoak diren edo ez. Momentuz ez dago eduki horiek zalantzarik gabe identifikatzeko modurik, baina hainbat konturi erreparatzea lagungarri gerta dakiguke.

Azken hilabeteotan adimen artifizialak (AA) izan duen garapenak fenomeno berri bat ekarri du: sare sozialen bitartez artifizialki sortutako irudien hedapen masiboa. Haietako batzuek nahasmen handia eragin dute erabiltzaileen artean, albiste politikoei lotutakoak izateaz gain, oso errealistak direlako.

Orain arte halako irudiak ziurtasun osoz identifikatzeko gai den tresnarik ez badago ere, inkoherentziak bilatzea edo testuingurua auzitan jartzea lagungarri izan daiteke, adituek AFP berri agentziari azaldu diotenez.

Hitz gako batzuetatik abiatuta irudiak sortzea da Midjourney, Craiyon, DALL-E edo Grok bezalako plataforma askoren printzipioa. Erabiltzaileen eskaerek etengabe elikatzen duten datu base handi batean oinarrituta hamaika irudi sortzeko gai dira tresna horiek.

Erabiltzaile askok umorea egiteko helburuarekin erabiltzen dute teknologia hau; beste batzuek, berriz, estetika hutsa bilatzen dute; baina badira beste batzuk irudiok albiste politikoekin lotzea aukeratzen dutenak, zio zehatzik gabe, edo nahita nahasmena eragin nahian.

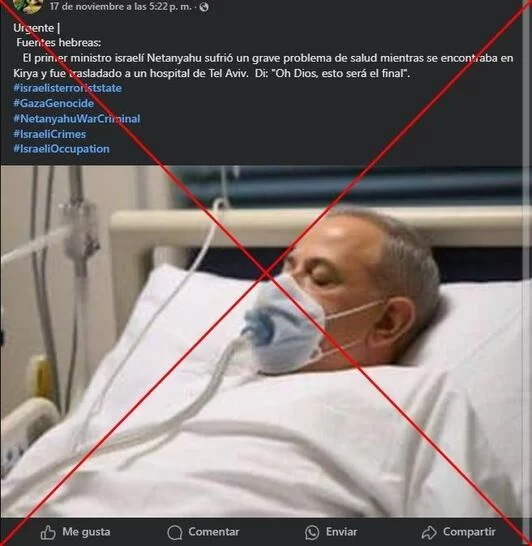

AA-k dakartzan aukera eta arriskuen inguruan hezi eta kontzientziatzeko sortutako atal berezian hainbat irudi bitxi jaso ditu azkenaldian NAIZek ere; esaterako, intubatutako Benjamin Netanyahuren irudi faltsu bat edo Donald Trump GARAren edizio berezi bat irakurtzen erakusten duena, erreportaje hau ilustratzen duenaren antzekoa.

Autore askok irudiak benetakoak ez direla zehazten duten arren –plataforma eta sare sozial batzuek ere automatikoki egiten dute ohartarazpena–, testuinguruz kanpo zabaldu eta egiazkotzat ere aurkeztu izan dira. Muntaia horiek detektatzen saiatzeko tresnak sortu dira edo garatzeko bidean daude, baina emaitzek oraindik zalantzarako tokia utz dezakete, AFPk berak egindako probek erakusten dutenez.

«Adimen artifizialak irudi oso bat sortzen duenean, ez du beste argazki batzuen zatirik erabiltzen. Milaka edo milioika argazki erabiltzen dira milaka milioi parametro kontuan hartzeko», azaldu zuen Austriako Teknologia Institutuko ingeniari David Fischingerrek.

«AA-k bere datu-bankutik fusionatzen ditu irudi horiek; deseraiki egiten ditu eta, ondoren, pixelez pixel argazki berri bat eraikitzen du. Horrek esan nahi du amaierako irudi errenderizatuan jada ez dugula nabaritzen jatorrizko irudien arteko aldea», esan zuen, bere aldetik Vincent Terrasik, Draft&Goal enpresaren sortzaileetako batek. Adimen artifizialak sortutako edukiak detektatzeko teknologia bat merkaturatu zuen startup horrek, unibertsitateei zuzendutakoa.

Argazkien metadatuak ere ez dira erabilgarriak izaten. Fitxategi baten nortasun-agiri digitala dira datuok eta, batzuetan, artifizialki sortutako irudien jatorria agerian uzten lagun dezakete. «Zoritxarrez, horretaz ere ezin duzu fidatu, sare sozialek informazio hori sistematikoki ezabatzen dutelako», nabarmendu zuen Annalisa Verdoliva aditu eta Napoliko Federico II.a Unibertsitateko irakasleak.

Iturria eta alderantzizko bilaketa

Adituek diotenez, artifizialki sortutako irudi bat detektatzeko modu bat haren jatorrizko testuingurua aurkitzea da. Kasu batzuetan, sortzaileak berak nabarmentzen du zein teknologia eta tresna zehatz baliatu duen.

Horretarako, argazkia interneten argitaratu zen lehen aldia identifikatzen saiatu behar dugu. Irudien alderantzizko bilaketa lagungarria izan daiteke eduki bat bilaketa-plataformetan indexatu ote den jakiteko. Hala, posible da argazki bera duten argitalpen zaharrak arakatzea.

Metodo horri esker, adibidez, sare sozialetan asko hedatu diren irudien jatorria ezagutu daiteke.

Jatorrizko erregistroa aurkitzea ezinezko zaigunetan ere, alderantzizko bilaketak kalitate hobeko bertsio batera eraman gaitzake, argazkia moztua edo aldatua izan bada, edo denboraren poderioz kalitatea galdu badu. Irudiak zenbat eta kalitate hobea eduki, orduan eta errazagoa izango da edizio horren zantzuak emango dizkiguten akatsak aurkitzea.

Irudien alderantzizko bilaketak antzeko argazkiak antzemateko abantaila du. Hori baliagarria izan daiteke argazki susmagarri bat iturri fidagarrien argazkiekin alderatzeko.

Era berean, argazkien deskribapenak edota erabiltzaileen iruzkinak baliagarriak izan daitezke muntaiak detektatu edo adimen artifizialeko tresna bakoitzaren estiloa identifikatzeko. DALL-E, esaterako, ultraerrealismoagatik da ezaguna, eta Grok edo Midjourney, aldiz, pertsona ospetsuetan oinarritutako sorkuntzengatik.

Irizpide hau ona izan daiteke argazki bakoitza jatorrizko plataforman bilatzeko. Midjourney-ren kasuan, erabiltzaileen eta programa automatizatuaren arteko elkarrizketak arakatzeak eraman gaitzake emaitza on bat lortzera.

Dena den, argazkia sortu duen tresna zein den jakiterik ez badugu, komeni da irudia sakonki aztertzea.

Irudiak aztertzeko zenbait gomendio

Ur-marka: Plataforma batzuek ur-markak sartzen dituzten beren sorkuntzetan. X sare sozialean jaio zen Grok tresnak, esaterako, bere izena sartzen du behe-eskuineko ertzean, eta Crayionek, aldiz, arkatz baten ikono txiki bat eransten du.

Nolanahi ere, kasu, plataforma guztiek ez dutelako ur-markarik jartzen eta, gainera, esportazioan hura kendu edo gerora moztu eta ezkutatzeko aukera ere badago.

Aintzat hartu beharreko beste kontu bat: baliteke ur-marka hori ikusgai ez egotea. DALL-E 3, esaterako, metadatuetan ere sartzen hasi zen 2024. urtearen bukera aldean. Esan behar da faktore horrek ere huts egin dezakeela, metadatuak ezabatzea ere badagoelako.

Irudiaren granulazioa: «Zalantzarik izanez gero, garrantzitsua da irudiaren pikortatzea behatzea, oso desberdina izango baita AAren sorkuntza baten eta benetako argazki baten artean», adierazi zion AFPri Tina Nikoukhah Paris-Saclayko Goi Eskola Normaleko matematika-laborategiko irudiak prozesatzen doktoreak.

AFPk frogatutako adimen artifizialeko tresnen doako bertsioetan, sortutako irudiek mugimendu hipererrealistako pinturen estilo nahiko antzekoa dute.

Inkonsistentziak bilatu: Adimen artifizialaren arloan aurrerapenak etengabekoak diren arren, eduki mota horietan akatsak agertzen dira oraindik ere. Ezagunenetakoa, adibidez, eskuak modu errealistan irudikatzeko adimen artifizialak izan duen zailtasuna da.

Adituek diotenez, akats horiek dira gaur egun fabrikatutako irudi bat ezagutzeko modu ona izan daitezke. Terrasiren esanetan, sarri errepikatzen dira hutsegite berberak eta, hala, horiek identifikatzea «7 akatsak edo desberdintasunak aurkitzeko jokoan aritzea bezalakoa da».

Nolanahi ere, Annalisa Verdolivak nabarmentzen du AAk egunetik egunera hobetzen ari direla, eta gero eta anomalia gutxiago dituztela.

Isladak: Adimen artifizialeko tresnek zailtasunak izan dituzte isladak sortzeko ere eta, horregatik, beste aukera bat izan daiteke ispiluei edo urari (argazkiak elementu horiek baldin baditu, noski) erreparatzea, edo begi-niniak aztertzea ere, normalean isla bat egoten baita argazkia ateratzen dugunean.

Beste ohartarazpen bat egiten du Terrasik begiez: «Askotan, begiak ez dira tamaina berekoak, batzuetan kolore ezberdinekoak».

Irudiaren hondoari begiratzea: Ikusmen-anomaliak, oro har, argazkiaren hondoan ezkutatzen dira. «Elementu bat zenbat eta urrunago egon, orduan eta desenfokatuago eta deformatuago egongo da eta perspektiba okerrak izango ditu», azaldu du adituak.

Sena findu: Baliteke elementu batzuk nahitaez desitxuratuta ez egotea, baina zentzurik ez izatea. Irudi baten originaltasuna auzitan jartzean, «ona da zentzuaz fidatzea», dio Terrasik.

Irudiak gertakari bat islatzen badu, baina jatorriari buruzko zalantzak baldin baditugu, onena da jazoerari buruzko informazioa bilatzea, iturri fidagarriek halako argazkirik argitaratu ote zuten edo gertakaria bera benetan gertatu ote zen jakiteko.

C2PA: gardentasunerako konpromiso bat

Jatorrira jotzearen ardura erabiltzaileen bizkar soilik ez uzte aldera, eman da beste urrats interesgarririk. 2021eko otsailean lehen pausoak eman zituen C2PA Coalition for Content Provenance and Authenticity delako protokoloa gero eta garrantzia handiagoa hartzen ari da irudiaren trazabilitatea bermatzeko.

Aliantza horren sortzaileen artean daude Microsoft, Intel, Adobe, BBC edota Truepic, eta gero eta enpresa edo talde handi gehiago ari dira bat egiten ekimenarekin: Amazon, Google, Meta, OpenAI...

C2PAren webgunean azaltzen denez, beren helburua «kolektiboki» estandar tekniko ireki bat sortzea da, editoreei, sortzaileei zein erabiltzaileei hainbat bitarteko motaren benetakotasuna eta jatorria ulertzeko modu malguak emateko.

Era berean, aitortzen dute egun ezinezkoa dela eduki digitala faltsua den edo ez antzematea, manipulaziorako softwarea gero eta sofistikatuagoa delako, metadatuak erraz manipulatu daitezkeelako eta ez dutelako jatorriaren frogarik ematen. Halere, lanean jarraitzen dute protokoloa hedatzeko eta euskarri zein iturri berrietara egokitzeko: fitxategi formatu berria, adimen artifizial sortzailea, bideoen zuzeneko emanaldiak eta audioak, besteak beste.

Argi uzten dute, nolanahi ere, ahalegin hauek nahitaezkoak bihurtzearen aurka daudela eta C2PA protokolo horren baitan partekatutako informazioa (nork sortu zuen edukia, noiz editatu zen…) egilearen esku geratzen da eta ezabatu daiteke. Mugak muga eta baldintzak baldintza, abiapuntu egokia izan daiteke.

¿Cuánto tiempo más existirán los glaciares? Un estudio calcula cuándo desaparecerá cada uno

2027ko urtarrilaren 10ean egingo dute Pantxoak eta Peiok ‘Azken dantza’

Descubren un colosal «valle de los dinosaurios» en el Stelvio con miles de huellas fósiles

Ikerketa batek eskolen jangeletako menuetan desoreka nutrizionalak antzeman ditu